Cuando Adriana Madrigal me compartió el vídeo publicado en el canal The Blind Life de YouTube sobre este bolso de viaje (la mochila FEELDOM TREK), confieso que nunca había oído hablar de la marca coreana FEELDOM. Y, siendo sincero, mi primera reacción fue de escepticismo. Como defensor convencido del diseño universal, suelo desconfiar de los productos que se anuncian como “adaptados” para personas con baja visión. Sin embargo, al investigar un poco más, descubrí que FEELDOM no fabrica mochilas “especiales”, sino piezas de alta calidad y diseño inteligente que resultan prácticas para cualquiera, con o sin discapacidad. Detrás de cada modelo hay una filosofía muy clara: combinar estilo, funcionalidad y accesibilidad real.

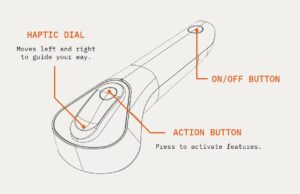

En InfoTecnoVisión hablamos de esta mochila porque no se trata solo de un accesorio elegante, sino de un complemento especialmente útil para una persona ciega. Quien utiliza bastón o perro guía suele tener al menos una mano permanentemente ocupada, por lo que contar con una mochila o bolso que se cuelgue del hombro o la espalda libera movilidad, mantiene el equilibrio y permite llevar objetos personales de forma segura y ordenada. Esa comodidad práctica, sumada al diseño táctil y al acceso rápido a cada compartimento, convierte a la FEELDOM TREK en un ejemplo perfecto de diseño inclusivo bien entendido.

Os invito a seguir leyendo para conocer la historia de esta marca, su proceso artesanal y los detalles que la han convertido en una referencia internacional en el diseño para todos.

Continuar leyendo “FEELDOM TREK: la mochila de viaje artesanal que une funcionalidad y diseño para todos”